Este contenido es parte de la Guía Completa para Stable Diffusion que puedes encontrar en esta web. La guía cuenta con los siguientes contenidos:

¿Quieres generar imágenes alucinantes con IA y de manera 100% gratuita? Entonces tienes que conocer Stable Diffusion, el Modelo de Inteligencia Artificial gratis que está redefiniendo la generación de imágenes a partir de texto.más potente para este uso.

En este artículo te hablaremos de qué es Stable Diffusion, cómo funciona, cómo utilizarlo y por qué es una herramienta relevante en el ámbito de la IA.

Si estás interesado en cómo la tecnología de vanguardia puede simplificar y mejorar la generación de contenido visual, sigue leyendo.

¿Qué es Stable Diffusion?

Stable Diffusion es un modelo de aprendizaje profundo que se lanzó en 2022. Este modelo tiene la asombrosa capacidad de generar imágenes detalladas a partir de descripciones de texto. ¿Quieres una imagen de «un gato tocando el piano bajo la luna llena»? Stable Diffusion lo hace posible.

Características Principales

- Generación de imágenes detalladas: Produce imágenes de alta calidad basadas en texto.

- Versatilidad: Más allá de la generación de imágenes, también puede restaurarlas, extenderlas y mucho más.

- Código abierto: Accesible para todos y puede ejecutarse en hardware de consumo.

- Es totalmente personalizable. Se le pueden añadir nuevos datasets de imágenes durante el entrenamiento para que aprenda nuevos conceptos y estilos visuales.

¿Cómo Funciona Stable Diffusion?

Este modelo utiliza un modelo de difusión latente para transformar texto en imágenes. En términos sencillos, toma una descripción de texto y la «difunde» a través de una serie de capas neuronales para generar una imagen.

Pasos Básicos

- Entrada de Texto: Introduces una descripción textual, lo que conocemos como «prompt». Por ejemplo «Magical realism, ghost riders in the sky» (importante, los prompts han de ser generados en inglés).

- Procesamiento: El modelo procesa el texto para entender qué le pedimos.

- Generación de Imagen: Stable Diffusion crea una o varias imágenes basadas en la descripción que le hemos dado.

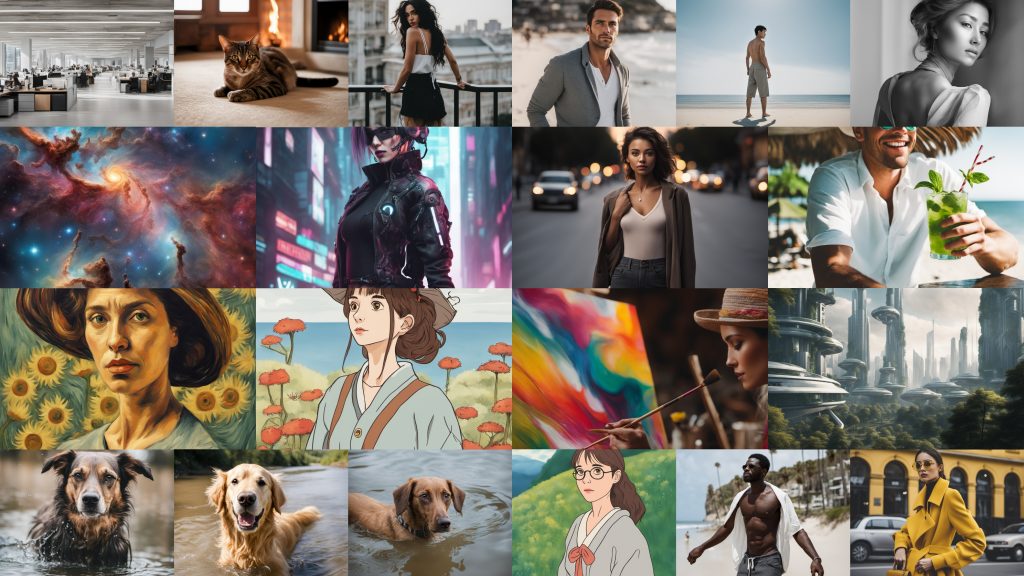

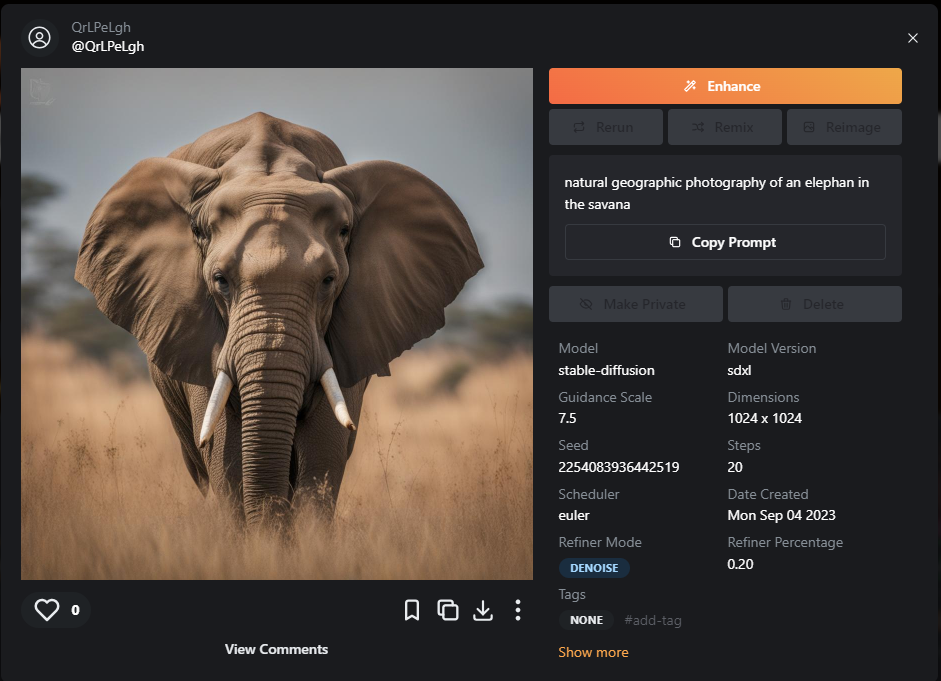

(Haz click para ampliar las imágenes)

¿Qué puede hacer Stable Diffusion?

Con Stable Diffusion puedes generar imágenes realistas (o no, lo que tú quieras) de personas, paisajes, animales, arte, … ¡Todo lo que entre en tu imaginación! Aquí tienes algunos ejemplos de imágenes generadas con Stable Diffusion:

a painting of a modern house in the style of van gogh

realistic portrait of a woman in the streets of tokyo, bussy street, at night

photo of a turtle in the beach having a mojito

a futurist landscape of mars

¿Stable Diffusion es gratis?

Al ser Open Source (de código abierto), Stable Diffusion es gratis si lo usas instalado de manera local en tu equipo, lo que requiere un ordenador potente.

No obstante, hay muchas opciones para usar Stable Diffusion gratis online o con un coste muy reducido, a continuación te las explicamos.

¿Cómo usar Stable Diffusion?

Aunque pueda parecer complicado, usar Stable Diffusion es más sencillo de lo que imaginas.

Para empezar, deberás elegir si quieres utilizarlo online (en un entorno web de terceros), en la nube (en un entorno online pero tuyo propio), o en local (instalándolo en tu ordenador). Ten en cuenta que para esta última opción tendrás que usar un ordenador con una tarjeta gráfica relativamente potente (unos 8GB de RAM).

Centrándonos en las formas de usar Stable Diffusion online, tenemos varias alternativas que podemos elegir:

- Con aplicaciones web (algunas gratuitas)

- Dream Studio

- ClipDrop

- Con una interfaz propia alojada en la nube

- Automatic111

- Stableswarm

- ComfyUI

Stable Diffusion Online

La mejor forma de probar Stable Diffusion para conocerlo y entender su potencial es a través de páginas web existentes en las que no tengamos que llevar a cabo instalaciones ni configuraciones complejas. Para ello, tenemos varias alternativas.

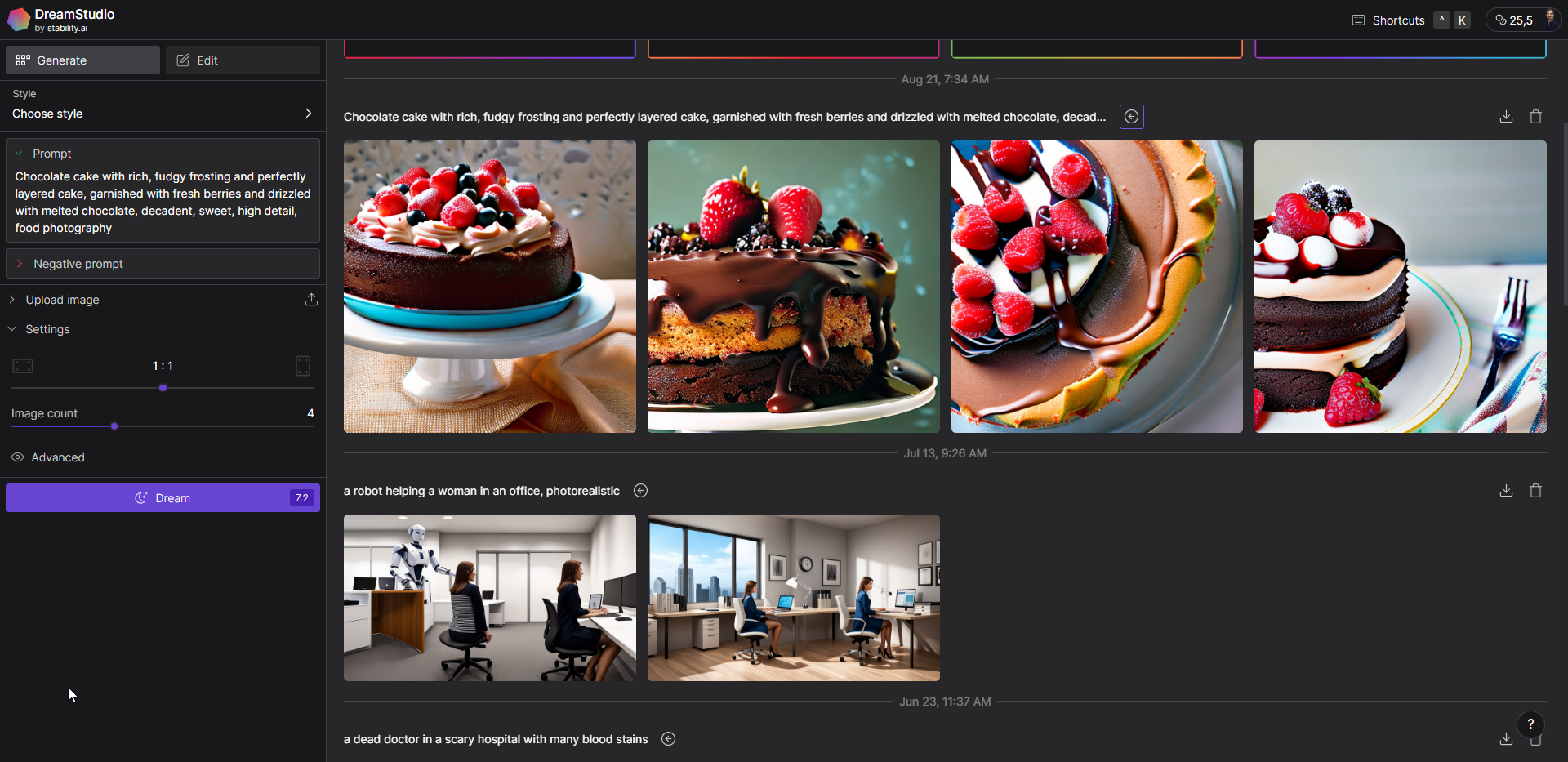

Dream Studio

Dream Studio es una plataforma oficial lanzada por Stability AI que permite utilizar todos los modelos de Stable Diffusion de manera sencillísima.

Al registrarte obtendrás algunos créditos gratis, aunque luego deberás pagar para ampliarlos. Es una solución barata y muy potente para la generación de imágenes con IA de forma sencilla:

Esta web sirve para generar, editar y mejorar imágenes de forma fácil y creativa. Con DreamStudio, puedes crear arte, fotografías e ilustraciones en cualquier estilo que imagines, usando modelos de inteligencia artificial exclusivos. También puedes modificar elementos dentro de tus imágenes, trabajar con múltiples imágenes a la vez y acceder a funciones avanzadas como estilos, máscaras, capas y escalado.

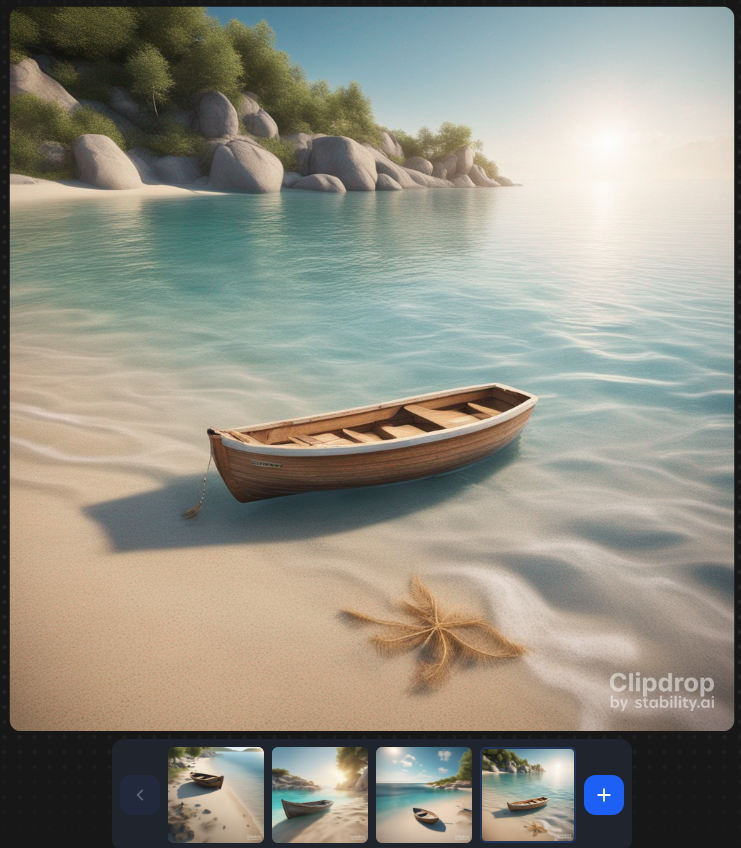

ClipDrop – Gratis

ClipDrop es otra alternativa para usar Stable Diffusion online, y además de manera gratuita nos va a permitir sacarle buena parte del potencial a la generación de imágenes (aunque teniendo que esperar una pequeña cola), así como a muchas otras herramientas de edición de imágenes basadas en IA, como son el reescalado, eliminación de textos, etc.

No obstante, los resultados con esta herramienta a la hora de generar imágenes no son los mejores.

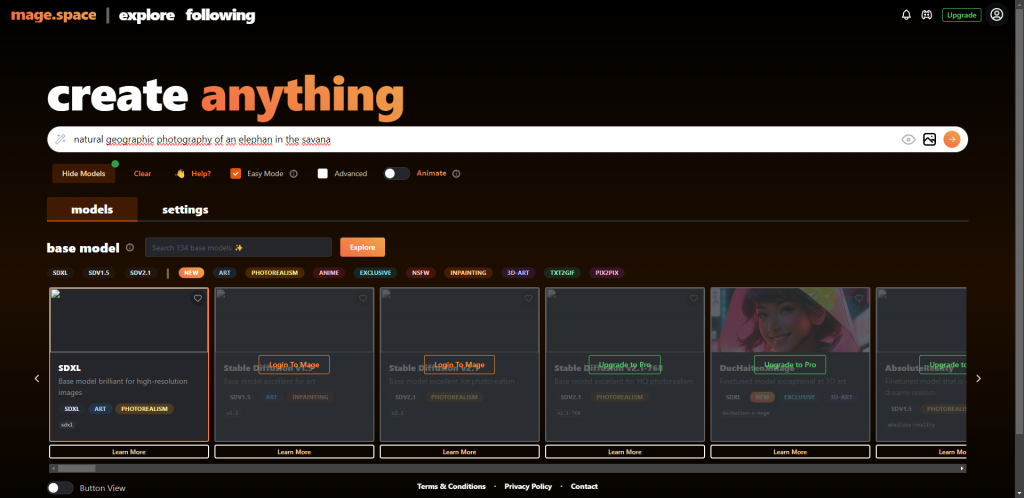

Mage es otra muy buena alternativa web para generar imágenes con Stable Diffusion de manera sencilla y gratuita. Podemos usar varios modelos (incluido SDXL) de manera gratuita, y si quieres acceder a una variedad más amplia de modelos, tienes opciones premium muy asequibles.

Stable Diffusion en la nube

Si quieres tener un mayor control y rendimiento sobre Stable Diffusion, te recomendamos utilizarlo mediante plataformas en la nube como Google Colab (con versión gratuita y de pago) o Runpod.

Para utilizarlo en la nube, tendrás que elegir entre las distintas opciones de interfaz (GUI) que existen para Stable Diffusion, a continuación te dejamos artículos con información sobre cada una de ellas:

- Automatic 1111

- StableSwarm UI

- Comfy UI

A día de hoy, la mejor alternativa consiste en usar Automatic1111 con Runpod, ya que ofrece un rendimiento buenísimo, y a un coste muy bajo (0,34$/hora). Aquí te dejamos una guía paso a paso para configurarlo en 90 segundos:

Claves para conseguir mejores imágenes con Stable Diffusion

Elige bien el prompt

Igual que cuando pides algo en un bar, pedirle a Stable Diffusion las cosas de la manera apropiada es la clave para conseguir lo que quieres. A la petición que hacemos al sistema se le llama «prompt». Aquí tienes una guía básica de creación de prompts para Stable Diffusion (si queires más detalles, aquí tienes la guía completa de prompts para Stable Diffusion).

Este es el punto más importante que debes controlar, ya que no vas a obtener el mismo resultado con un prompt sencillo y sin pensar, que con un prompt elaborado de manera correcta.

Por ejemplo, si le pedimos a Stable Diffusion «a dog in the water», nos sale esto:

No está mal pero le falta algo de alegría a la imagen, al perro al entorno…

Sin embargo, si creamos un prompt algo más elaborado: «a golden retriever in a river, on a sunny day, with happy expression»

Claramente, el resultado es mucho más atractivo y profesional, además de que tenemos mucho más control sobre las imágenes que genera la IA.

Elige el modelo

Configura bien la herramienta

- Image size (Tamaño de la imagen): se refiere al tamaño de la imagen de salida. El tamaño estándar es de 512×512 píxeles. Cambiarlo a tamaño vertical u horizontal puede tener un gran impacto en la imagen. Por ejemplo, puedes utilizar el tamaño vertical para generar una imagen de cuerpo completo.

- Sampling Steps (Pasos del muestreo): utiliza al menos 20 pasos. Normalmente se recomienda usar 30.

- CFG Scale (Escala CFG): el valor típico es 7. Auménaloe si quieres que la imagen sea más fiel al prompt, o bájalo si quieres dar más libertad a Stable Diffusion.

- Seed value (Valor inicial): -1 genera una imagen aleatoria. Si especificas un número concreto, saldrá una imagen similar a una anterior.

¿Qué lo Diferencia de Otras Herramientas?

Si has oído hablar de otras herramientas de generación de imágenes con IA como son DALL-E o Midjourney, podrías preguntarte qué hace que Stable Diffusion sea especial. Aquí hay algunas diferencias clave:

- Frente a DALL-E 2 de OpenAI o Midjourney, que son un modelos cerrados y de pago, Stable Diffusion es open source y gratuito.

- Tiene menos restricciones que DALL-E sobre los contenidos que se pueden generar. Por ejemplo, permite generar imágenes realistas de personas y famosos.

- Es más fácil de usar localmente que DALL-E 2, ya que no requiere una API ni cuotas de generación.

- La calidad de imagen máxima de 1024×1024 supera los 1024×768 píxeles de DALL-E 2.

- Permite entrenar el modelo con nuevos datasets para personalizarlo. Esto no es posible con DALL-E 2 o Midjourney.

-

Requisitos de Hardware. Stable Diffusion puede ejecutarse en una GPU modesta con al menos 8 GB de VRAM, lo que lo hace más accesible para el usuario promedio.

En definitiva, Stable Diffusion ofrece un equilibrio entre facilidad de uso, customización y menos limitaciones para el usuario. Todo ello de forma open source y gratuita.

Usos y aplicaciones de Stable Diffusion

La capacidad de Stable Diffusion para generar imágenes fotorrealistas a partir de descripciones textuales habilita múltiples casos de uso innovadores:

- Ilustración automatizada de escenas o personajes según descripciones. Útil para artistas y diseñadores.

- Edición visual mediante transformaciones en el texto de entrada. Por ejemplo cambiar atributos en retratos generados.

- Creación de datasets de imágenes para el entrenamiento de otros modelos de IA relacionados con visión artificial.

- Diseño de interiores/exteriores generando renderizados realistas de propuestas creativas.

- Conceptualización de productos, creando imágenes fotorrealistas de productos imaginados a partir de descripciones.

- Animación, generando secuencias de imágenes ligeramente diferentes que luego se ensamblan en un vídeo.

Las aplicaciones son prácticamente ilimitadas para cualquier campo que requiera sintetizar escenas o diseños visuales realistas de forma rápida y sencilla.

Historia de Stable Diffusion y su relevancia

Stable Diffusion fue presentado oficialmente en agosto de 2022 por la empresa Stability AI tras meses de arduo trabajo y entrenamiento del modelo.

Sus creadores son figuras destacadas en el mundo del aprendizaje profundo, como Emad Mostaque, Liam Paull y Alex Birch.

La versión 1.0 de Stable Diffusion representó un gran avance en la calidad y fidelidad de las imágenes generadas por inteligencia artificial a partir de descripciones en lenguaje natural.

Fue entrenado principalmente con un conjunto de datos llamado LAION-5B, que contiene alrededor de 5.000 millones de imágenes asociadas a descripciones en inglés extraídas de texto disponible públicamente en internet.

Otros investigadores han seguido entrenando el modelo con nuevos datasets de ilustraciones de anime, imágenes médicas y muchos otros, lo que ha permitido mejorar la diversidad de imágenes que puede generar Stable Diffusion.

En resumen, Stable Diffusion bebe de años de investigación previa en modelos generativos y redes neuronales, e integra los últimos avances para establecer un nuevo estado del arte en la síntesis de imágenes por IA.

¿Por qué es Relevante Stable Diffusion?

- Innovación en IA: Representa un avance significativo en la generación de imágenes basadas en texto.

- Accesibilidad: Al ser de código abierto, democratiza el acceso a la tecnología de IA de vanguardia.

- Aplicaciones Versátiles: Desde el arte digital hasta la medicina, las aplicaciones son prácticamente infinitas.

¿Cómo está hecho Stable Diffusion?

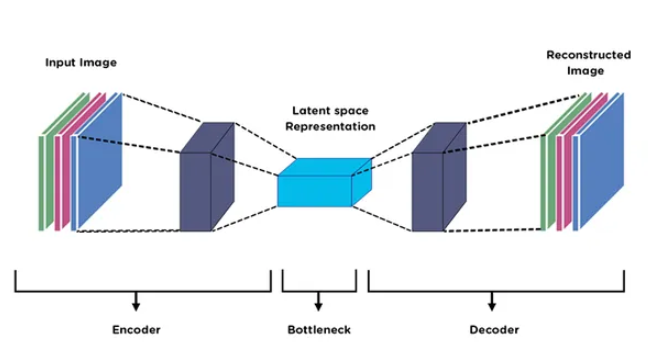

Resumiedo mucho, Stable Diffusion utiliza una arquitectura llamada «autoencoder» que consta de dos partes:

- Un codificador que convierte el texto de entrada en un vector latente.

- Un decodificador que convierte ese vector en una imagen.

Durante el entrenamiento, el modelo aprende a generar imágenes que coinciden con la descripción de entrada.

Conclusión

En definitiva, Stable Diffusion representa uno de los últimos grandes hitos en inteligencia artificial generativa aplicada a imágenes y creatividad visual.

Ofrece un equilibrio imbatible entre facilidad de uso, flexibilidad y potencia. Todo ello de forma open source y gratuita.

Según vaya mejorando y entrenándose con más datos, esta tecnología tiene el potencial de revolucionar tareas creativas e imaginativas relacionadas con el diseño visual y la imagen.

El futuro es prometedor y están por verse los límites de lo que esta tecnología permitirá crear en manos de usuarios creativos de todo el mundo.